一、写给想自己跑 AI、但不太懂电脑配置的你

很多人想在自己电脑上跑 AI——不交月费、数据不出门,但一搜教程就看到「4B」「7B」「显存不够」「要 16GB 内存」之类的词,不知道什么意思,更不知道自己的电脑能不能跑。这篇文章就是帮你先把这些概念搞懂,这样你再去看具体怎么装 Ollama、怎么选 Klein,心里就有数了。

下面会说到三件事:4B、9B 这些数字到底啥意思;本机跑 AI 要看电脑的哪几样东西(显存、内存、还有「精简版」模型);不同大小的模型大概需要什么样的电脑。中间会教你怎么查自己电脑的显存和内存,以及选模型时容易踩的坑。不涉及具体软件安装,看完你再去跟着 Ollama、Klein 的教程做就行。

二、4B、9B 里的「B」是啥意思?

B 就是「十亿」的缩写(英文 billion)。4B 表示这个模型大概有 40 亿个参数,7B 是 70 亿左右,9B 是 90 亿。你可以简单理解成:数字越大,模型越大、越「重」,占的磁盘空间和运行时要用的「工作空间」也越大。

所以当你看到「Llama 7B」「Klein 4B」这种名字时,后面的 7B、4B 就是在说这个模型有多大。还有 1.5B、3B、14B、70B 等,单位都一样,都是十亿。一般来说,数字越大,模型能力可能越强,但对电脑要求也更高。

有两点容易搞混,这里先说清:

- 不是数字越大就一定越好用。同样 7B,不同公司出的模型效果可能差很多;所以选模型时除了看数字,也要看大家推荐哪个。但对你来说,先看自己电脑能跑多大的,再在这个范围里挑口碑好的,最实际。

- 数字越大,对电脑要求越高。模型要占硬盘空间(下载下来的文件),跑的时候还要占「显存」或「内存」。所以你首先得知道:我的电脑能撑住几 B?再决定选 4B、7B 还是更大的。

平时大家说的「小模型」「大模型」,也是按这个数字来分的:几 B 到十几 B 算小模型,几十 B 算大模型。想在自己电脑上跑,先对号入座自己设备能跑多「大」,再在这个档位里选具体型号,比一上来就盯着 70B 靠谱。

三、本机跑 AI,要看电脑的哪几样东西?

和你「能不能跑、跑得顺不顺」直接相关的,主要是这几样:显存、内存、模型有没有「精简版」、以及你用的是哪种电脑。

显存和内存:不是一回事

内存就是你买电脑时说的「8G 内存」「16G 内存」——电脑主板上插的那块,所有程序都要用。看内存很简单:Windows 打开任务管理器就能看,Mac 点左上角苹果菜单 →「关于本机」,第一行就有。

显存是显卡自带的「小内存」,专门给显卡干活用的。很多 AI 模型跑的时候主要吃显存;显存不够就会报错、卡死,或者自动改用电脑主内存跑,那样会慢很多。所以如果你用的是带独立显卡的 Windows 电脑,除了看内存,更要看显存有多少 G。

这里有个坑:很多笔记本写「16G 内存」,但显卡的显存只有 4G 或 6G。文档里要是写「需要 8G 显存」,指的不是你那 16G 内存,而是显卡的显存,所以一定要分清。用 Mac(尤其是 M 系列芯片的苹果电脑)的话,采用的是统一内存架构:CPU 和 GPU 共用同一块物理内存,没有像独立显卡那样单独的显存芯片,所以就看你这台 Mac 总共有多少 G 内存(关于本机里看到的那个)。

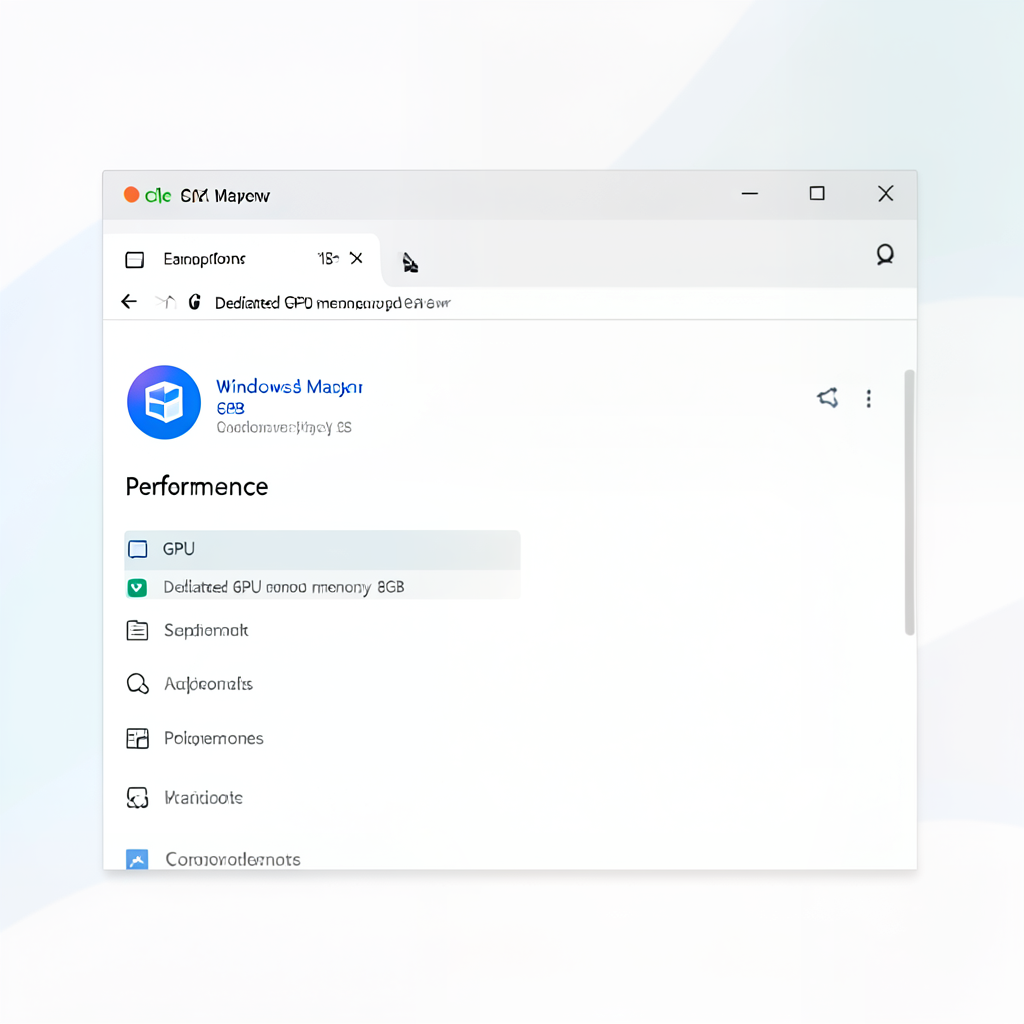

怎么查自己电脑的显存和内存?

- Windows:按

Ctrl + Shift + Esc打开任务管理器,点顶上的「性能」;左边选「GPU」,下面会写「专用 GPU 内存」或类似字样,那就是显存;选「内存」那一项,就是你的电脑内存。 - Mac:点左上角苹果菜单 →「关于本机」,第一行「内存」就是;M 系列是统一内存,CPU 和 GPU 共用,就看这个数字。

- 查完之后,和你要跑的模型要求的「显存」或「内存」对比一下,最好留一点余量,别刚好卡线。

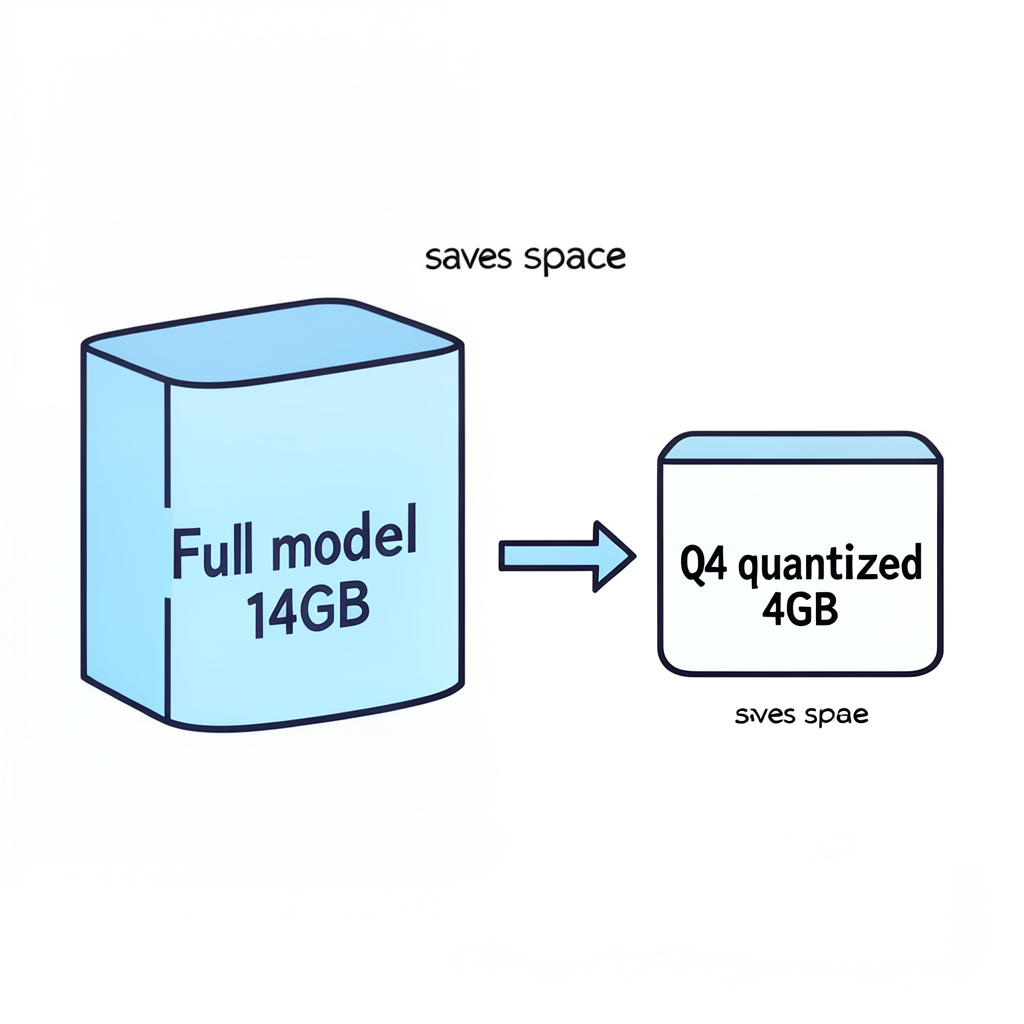

「精简版」模型:Q4、Q8 是什么?

同一个模型(比如同一个 7B)往往会有好几个版本:有「完整版」(占空间大、要的显存多),也有「精简版」(把模型压缩后,占的空间和显存都小,效果略差一点,但很多人用着够)。这种压缩过的版本一般叫量化,名字里常带 Q4、Q8 等。

你不需要搞懂 Q4、Q8 的技术细节,只要记住:数字越小越「精简」,占的空间和显存越少,对电脑要求越低;效果会略逊于完整版,但日常聊天、生图、写写东西通常够用。例如同一 7B 模型,完整版可能要十几 G,Q4 精简版可能只要 4G 左右,差距很大。

所以:如果你电脑显存或内存不太够,或者磁盘空间紧张,优先选带 Q4、Q8 这种标签的版本;电脑配置比较好的,再考虑完整版。

你用的是哪种电脑?

Windows 台式机或笔记本,有独立显卡(N 卡):主要看显卡的显存有多少 G;显存不够就选小一点的模型或精简版(Q4、Q8)。显卡驱动太老也可能跑不了,需要更新一下。

苹果电脑(M 系列芯片):采用统一内存架构,CPU 和 GPU 共用同一块内存,没有独立显卡那种单独的显存芯片,所以看整机内存即可。8G 能跑小模型,16G 会从容很多,24G 或以上可以试试更大的模型。很多软件已对 M 系列优化,包括用 Ollama 跑对话和生图(目前生图主要在 Mac 上支持得好)。

没有好显卡、只能用「电脑主内存」跑:也能跑,但会很慢,一般只适合很小的模型(比如 1B~3B)试试水;7B 以上的用纯 CPU 跑,很多人会嫌慢。

本机跑的好处和代价

本机跑最大的好处是数据都在你自己电脑上,对话、文件、生成的图不会上传到别人服务器,适合不想用云端、或者公司/行业对数据有要求的人。代价是你得自己装软件、留够磁盘空间、遇到报错要会查会搜;如果完全不想折腾,用 ChatGPT 那种在线服务会更省事。

自建 AI ≠ 能做到 ChatGPT、DeepSeek 那种水平

有一点要心里有数:在自己电脑上跑开源模型,并不等于能做到市面上的 ChatGPT、DeepSeek、Claude 那种体验。不是说自建没用,而是「能跑起来」和「和顶流产品一样强」是两回事;搞清楚差距在哪,才能按自己的需求选——是更在意隐私和可控,还是更在意效果和省心。

原因大致有几条。一是投入不在一个量级:ChatGPT、DeepSeek 这类产品背后是海量数据、大批 GPU、长期训练和迭代,投入成本极高;开源模型多是机构或社区在有限资源下做出来的,能力再强也难以和那种投入相比。二是你本机的算力有限:再好的开源模型,跑在你自己的电脑上,模型大小和推理速度都会受显卡或内存限制,很难复刻云端那种「超大模型 + 大批服务器」的配置。三是闭源产品还有不少「看不见的优化」:推理加速、提示词工程、多模型组合、持续更新等,本地很难一比一复刻。

总结一下:自建 AI 的价值在于数据在你手里、不交月费、可定制、能学习。设备够用的话,完全可以拿来自建 AI 知识库、内部 Wiki、公司知识库等正经用途,不限于「玩玩学一学」;只是和 ChatGPT、DeepSeek 那种顶流产品的整体体验相比,仍有差距。如果你追求的是「和顶流一样聪明、一样快」,现阶段用现成的在线服务更现实;如果你更在意「数据别上传」「自己能掌控」,或者就是要做私有知识库、内部问答,自建就很有意义。先想清楚自己要什么,再决定以自建为主、以云端为主,还是两个都试试。

四、不同大小的模型,大概需要什么样的电脑?

下面这个表是一个大概参考,让你对号入座:你的电脑大概能跑「几 B」的模型。不同软件、不同模型会有差异,具体以你要用的那个模型或 Ollama 页面写的为准。

| 模型大小(约) | 你的电脑大概需要 | 适合什么样的电脑 |

|---|---|---|

| 1B~3B | 8G 内存可以试;有 6G 显存会更顺 | 轻薄本、老电脑、先体验一下 |

| 7B~8B | 建议 16G 内存;有 6~8G 显存较顺畅,用精简版可以再低一点 | 最常见的「小模型」,日常对话、写写东西 |

| 13B~14B | 一般要 32G 内存或 12G 以上显存 | 配置比较好的台式机或高配本 |

| 30B~70B+ | 多数要 24G 以上显存或高配 Mac | 「大模型」,普通笔记本很难跑得动 |

生图模型(比如 Klein 的 4B、9B)同样用 B 表示大小,但和对话模型架构不同,占用的显存/内存规律也不一样。有的 4B 生图模型在 Mac 上标「约 5.7G」,在 Windows 上可能写「建议 8G 显存」,以你用的软件或模型页面说明为准。

你可以这样选:先按上面教的方法查一下自己电脑的显存或内存 → 对着表看自己大概落在哪一档(比如 8G 显存就主要考虑 7B 及以下,优先选精简版)→ 在这一档里再按需求选具体模型(要中文好、要能生图等)→ 最后去看这个模型的安装教程,按步骤来。

五、选模型时容易踩的坑

这几条很多人会搞错,提前注意能少走弯路:

- 把「内存」和「显存」搞混。文档里写「需要 16G」时,要看清楚是显存还是内存。很多笔记本标 16G 内存,但显卡显存只有 4G 或 6G,跑 7B 完整版会卡甚至跑不起来。

- 觉得数字越大越好。电脑有限的话,一个跑得流畅的 7B 精简版,往往比一个卡成幻灯片的 13B 实用;先跑稳了再考虑往大里选。

- 不看有没有精简版就下「完整版」。很多模型都提供 Q4、Q8 等版本,体积能差一倍以上;先看自己显存/内存多少,再选版本,不然容易下完发现跑不动。

- 没看支持什么系统。有的功能只支持 N 卡,有的只支持 Mac(比如目前 Ollama 生图主要支持 macOS);选之前看一眼说明里写的「支持哪些电脑」。

六、小结:你先做哪几步

简单回顾一下:4B、7B、9B 里的 B 表示十亿,数字越大模型越大、对电脑要求越高。本机跑的时候要看清楚是显存还是内存、有没有精简版(Q4、Q8)可以省资源,以及你用的电脑类型(N 卡 PC / Mac / 只有内存的电脑)。上面的表可以帮你对号入座自己大概能跑多「大」的模型。

建议你这样来:先查自己电脑的显存或内存 → 对照上面的表,看自己能跑哪一档 → 在这一档里选一个带精简版的、或者大家推荐多的模型 → 再去找这个模型或工具的教程(比如《Ollama官方文档导读》、Klein 4B/9B),跟着装、跟着跑。搞清楚「我的电脑能跑几 B」「该选哪个型号」之后,后面就顺了。